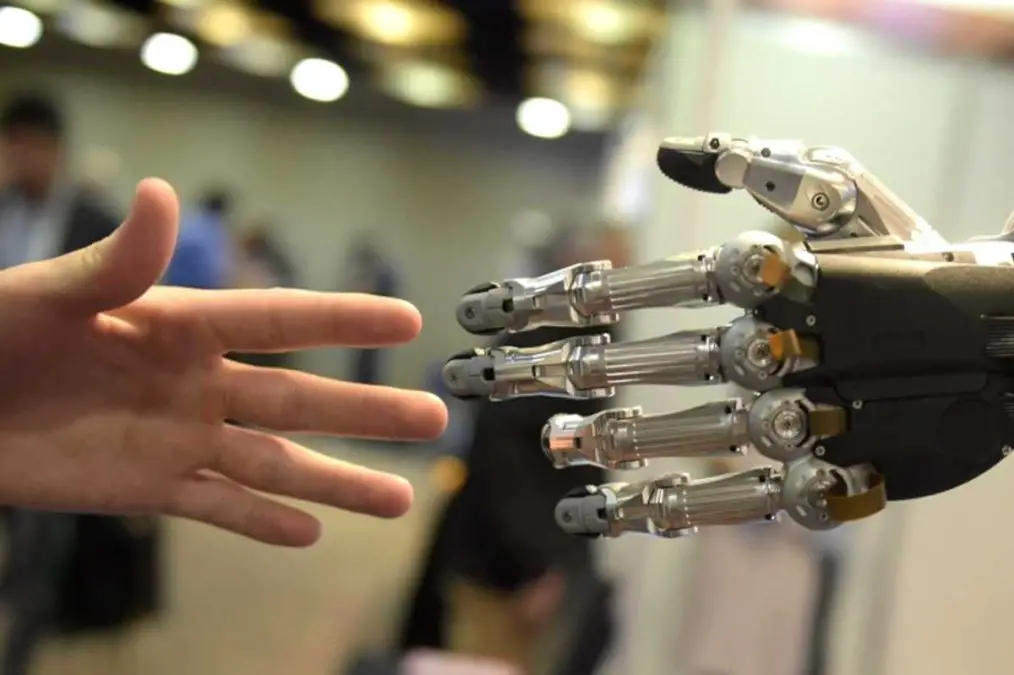

Permettre aux robots de faire preuve de compétences sociales pourrait conduire à des interactions homme-robot plus fluides et plus positives à l’avenir.

Le règne des robots est à nos portes, il arrive inévitablement pour aider l’humanité à passer à une autre étape de la marche de la civilisation humaine, et a déjà commencé à prendre sa place dans nos vies.

Les robots aident désormais à livrer des aliments, à livrer des commandes, à récolter des champs et à effectuer de nombreuses tâches dans tous les domaines de la vie.

En fait, ce n’est que le début – ce que nous verrons dans les années à venir dépasse de loin ce que l’imagination ordinaire peut envisager.

La taille du marché mondial de la robotique devrait atteindre 10,47 milliards de dollars d’ici 2027, avec un taux de croissance de plus de 43,4 % au cours de la période de prévision 2021-2027, selon la plateforme dite « Energy Siren » récemment.

Avec cette croissance constante, de nombreuses personnes s’interrogent sur le niveau de confiance dans ces robots. Est-il possible d’instaurer une confiance entre les humains et les robots ou les différents systèmes et programmes d’intelligence artificielle qui aident les employés et les ouvriers à accomplir leurs diverses tâches ?

C’est ce à quoi un professeur travaillant à l’Université américaine de Géorgie, avec l’aide de l’armée américaine, tente de répondre afin d’instaurer la confiance et de combler le fossé entre les humains et les machines, selon la plateforme de l’université.

La confiance est une question de vie ou de mort

Le professeur Aaron Schecter, professeur associé au département des systèmes d’information de gestion du Terry College de l’université de Géorgie, a reçu deux subventions de l’armée américaine d’un montant de près de 2 millions de dollars pour étudier les interactions homme-robot.

Alors que l’IA à la maison peut aider à commander des produits d’épicerie ou de la nourriture, l’IA sur le champ de bataille opère dans un ensemble de circonstances plus dangereuses, où la coopération et la confiance entre des soldats travaillant dans la même équipe peuvent être une question de vie ou de mort.

Dans ce contexte, M. Schekter déclare : « Dans l’armée, et pendant les combats sur le terrain, vous voulez avoir des robots qui peuvent coopérer et effectuer des tâches qui réduisent la charge des soldats, et en même temps gagner la confiance de ces soldats… L’objectif est d’instaurer la confiance entre les deux parties.

Bien que le célèbre film Terminator soit la première chose qui vienne à l’esprit lorsqu’on parle de robots militaires, M. Schecter explique que des travaux sont en cours pour développer des robots capables d’effectuer des missions d’éclaireur avancées ou de porter de lourdes charges à la place des soldats d’infanterie, qui sont souvent obligés de porter environ 80 livres d’équipement sur leur dos.

« Imaginez un drone sans télécommande, volant au-dessus des soldats comme un oiseau de compagnie, arpentant la route et fournissant des conseils audio en temps réel du type : la route à votre droite est cahoteuse, dangereuse et pleine d’embuscades, je vous recommande de prendre la route à gauche », explique Schekter.

« Nous ne voulons pas que les gens détestent, n’aiment pas ou ignorent les robots, mais ils doivent être prêts à leur faire confiance dans des situations de vie ou de mort pour qu’ils soient efficaces. Alors comment faire en sorte que les gens fassent confiance aux robots, à l’IA ? »

Pour répondre à cette question importante, le professeur Rick Watson – un collègue du professeur Schecter avec lequel il a coécrit des ouvrages et des recherches spécialisés dans l’intelligence artificielle – estime que « l’étude de la façon dont les machines et les humains travaillent ensemble deviendra de plus en plus importante à l’avenir, surtout si l’intelligence artificielle atteint des niveaux avancés et sans précédent. « .

Les limites de l’intelligence artificielle

« Je pense que nous allons voir beaucoup de nouvelles applications de l’IA », a déclaré Watson, « et nous allons devoir savoir quand cela fonctionne bien, et bien sûr nous pouvons éviter les situations où cette intelligence est dangereuse pour les humains, ou du moins éviter ces situations où il est difficile de justifier une décision prise par les robots. » C’était une mauvaise décision d’un point de vue humain. L’intelligence artificielle a des limites, et nous devons en être pleinement conscients et y faire face ».

Comprendre quand les systèmes d’IA et les robots fonctionnent bien a conduit Schecter à prendre ce qu’il sait du fonctionnement des équipes humaines et à l’appliquer à la dynamique de travail des humains et des robots.

« Les recherches que je mène ne sont pas axées sur la conception et la construction de robots, mais davantage sur l’aspect psychologique : quand peut-on faire confiance à quelque chose, sur quels mécanismes repose la confiance, comment faire pour que les humains coopèrent dans ce domaine ? ». Les humains sont très tolérants à l’égard des erreurs, mais si un robot en commet une, peut-il être pardonné ?

Schecter a d’abord recueilli des informations sur les moments où les gens étaient le plus susceptibles de suivre les conseils du robot. Puis, dans le cadre d’une série de projets financés par le bureau de recherche de l’armée, il a analysé la manière dont les humains traitaient les conseils de la machine et l’a comparée à celle dont ils traitaient les conseils des autres.

Faire confiance aux algorithmes

Dans l’un des projets de recherche, l’équipe de M. Schecter a présenté des sujets spécifiques à tester, comme le tracé du chemin le plus court entre deux points sur une carte. L’équipe a constaté que les gens faisaient davantage confiance aux conseils de l’algorithme qu’à ceux des humains.

Dans une autre étude, son équipe a trouvé des preuves que les humains peuvent faire confiance aux algorithmes pour d’autres tâches, comme résoudre des associations de mots ou réfléchir à un problème, en analysant toutes ses dimensions, ses implications futures et la meilleure façon de le résoudre.

Commentant les résultats, M. Schecter a déclaré : « Nous étudions la manière dont les algorithmes ou l’intelligence artificielle peuvent affecter la prise de décision humaine. Nous avons testé une variété de tâches dans le but de déterminer quand les gens font plus confiance aux algorithmes qu’aux humains. Nous avons constaté que lorsque les gens effectuent des tâches analytiques, ils font davantage confiance aux algorithmes et aux ordinateurs, et il est intéressant de noter que cette tendance s’est étendue à d’autres activités. »

« Il s’agit d’un domaine très important pour instaurer la confiance entre les humains et les robots », ajoute-t-il.

Les robots peuvent-ils acquérir des compétences sociales permettant d’instaurer la confiance entre eux et les humains ?

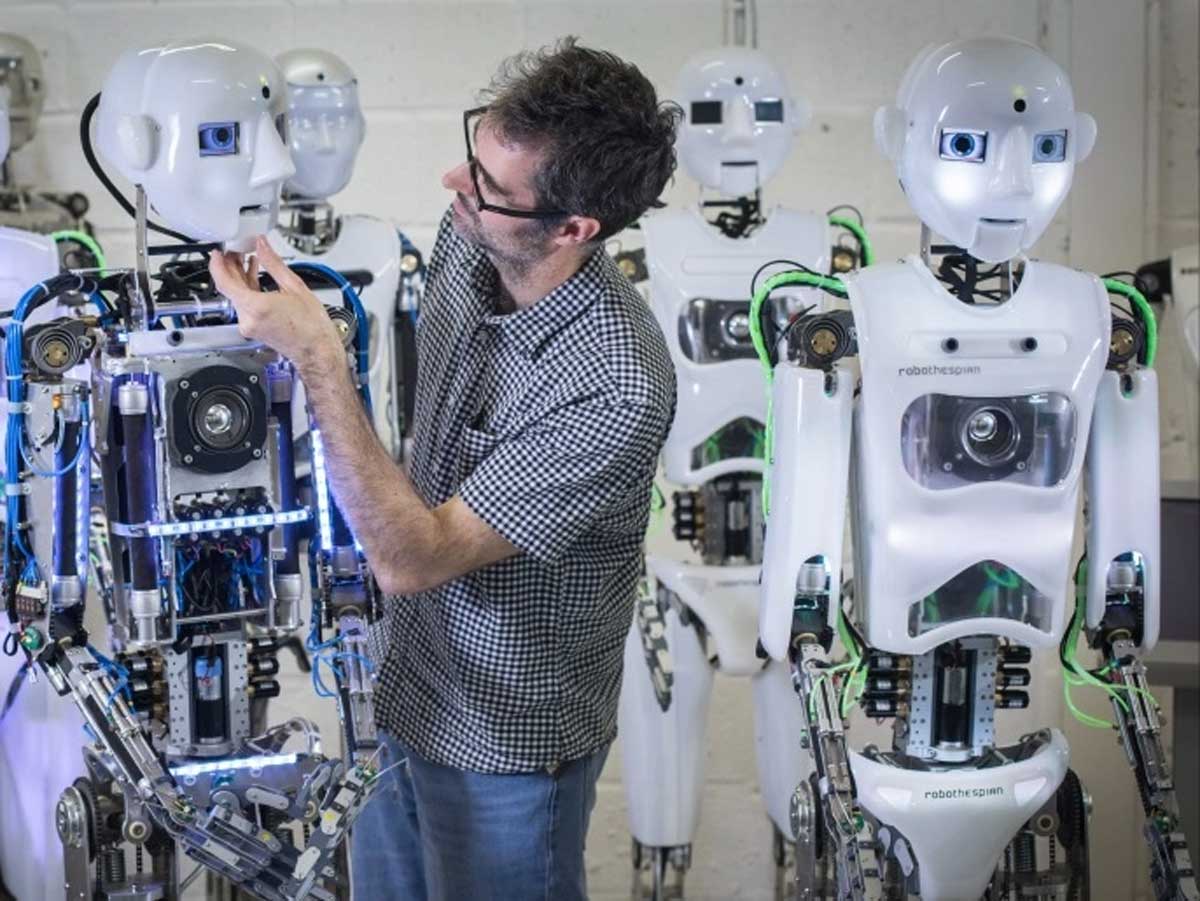

C’est ce à quoi un groupe de chercheurs de la Massachusetts Tech University (États-Unis) a tenté de répondre en concevant un nouveau système d’apprentissage automatique qui aide les robots à comprendre et à réaliser certaines interactions sociales avec les humains, permettant ainsi aux machines de comprendre ce que signifie aider ou être aidé. Et apprenez à adopter ces comportements sociaux. Tout seul, selon la plateforme universitaire qui a publié la recherche.

Les chercheurs ont conçu un environnement simulé spécial dans lequel le robot observe son partenaire, devine la tâche qu’il veut accomplir, puis aide ou gêne l’autre robot en fonction de ses propres objectifs.

Les chercheurs ont démontré que leur modèle était capable de créer des interactions sociales réalistes et prévisibles, puis l’équipe a montré des vidéos spéciales de robots interagissant les uns avec les autres devant des humains, où les spectateurs humains ont convenu que les comportements sociaux affichés par les robots étaient valides.

Permettre aux robots de démontrer leurs aptitudes sociales pourrait conduire à des interactions homme-robot plus fluides et plus positives à l’avenir.

Dans ce contexte, le professeur Boris Katz, professeur au Computer Science and Artificial Intelligence Laboratory (CSAIL) du MIT, déclare : « Les robots vivront très bientôt dans notre monde et il est urgent qu’ils apprennent à communiquer avec nous en termes humains… Il s’agit d’un travail très précoce et nous ne faisons qu’effleurer la surface, mais je pense qu’il s’agit de la première tentative sérieuse de comprendre ce que signifie l’interaction sociale entre les humains et les machines.

Il ne fait aucun doute que les robots arrivent inévitablement et qu’ils vont tout changer dans nos vies, y compris notre comportement et notre vision sociale de nous-mêmes d’abord et de la vie ensuite, à la lumière d’un monde qui est devenu numérique en tout, y compris nos sentiments humains.